R-неокогнитрон теряет свою эффективность при большом числе классов, к которым могут принадлежать образы, так как время распознавания возрастает экспоненциально в зависимости от числа нейронов.

TD-R-Неокогнитрон выполняет т.н. ментальный поворот образа, определяя угол и сравнивая с эталоном. Данный принцип имеет много общего с поведением человека: когда человек смотрит на картину, повернутую на 90 градусов, он определяет угол и старается наклонить свою голову, чтобы понять, что нарисовано на картине.

Обзор существующих методов

На данный момент существует несколько версий реализации неокогнитрона, имеющие незначительные различия:

- Модели, основанные на методе обучения "без учителя"

- Модели, основанные на методе обучения "c учителем"

Последние обладают более высокой скоростью обучения и стабильностью. Однако их недостаток в том, что предполагается использование дополнительной информации о принадлежности всего входного образа целиком и его отдельных частей к тому или иному классу.

Модели, которые обучаются без учителя, являются более адаптивными и оптимальными. Они базируются на представлениях о зрительной системе восприятия человека.

Структура Неокогнитрона

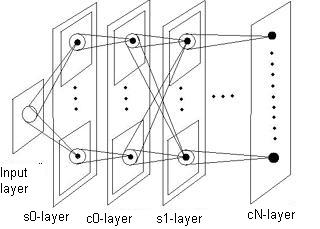

Неокогнитрон представляет собой многослойную самоорганизующуюся нейронную сеть, которая моделирует систему восприятия человека. Его слои состоят из множества нейронов, сгруппированных в плоскости - двумерные массивы. Нейрон одного слоя получает сигналы от ограниченного числа нейронов предыдущего слоя, и посылает выходные сигналы небольшому числу нейронов следующего слоя.

В структуре неокогнитрона используются три типа нейронов - S-нейроны ("простые" нейроны), C-нейроны ("сложные" нейроны) и тормозящие нейроны. Подробнее о функционировании каждого из них - в разделе Описание нейронов. Слои сгруппированы парами, за каждым S-слоем, содержащим одни только S-нейроны, следует C-слой. Плоскости любого S-слоя обучаются распознавать определенные особенности входного образа, а плоскости C-слоев комбинируют результаты распознавания.

Рисунок 1.1 - Структура Неокогнитрона

Количество нейронов в плоскостях уменьшается от слоя к слою. Последний C-слой содержит множество плоскостей, содержащих по одному нейрону, реагирующему на определенный входной образ. Входной слой содержит одну плоскость нейронов, и передает распознаваемый образ на вход первому S-слою.

Каждая плоскость S-слоя получает входные сигналы ото всех плоскостей предыдущего C-слоя, т.е. каждый нейрон в любой S-плоскости связан с группами нейронов из всех C-плоскостей, позиционно расположенных в одних и тех же областях. Нейроны плоскости C-слоя получают входные сигналы только от нейронов соответствующей ей плоскости предыдущего S-слоя.

Каждый нейрон реагирует на выходные сигналы нейронов предыдущего слоя, лежащих в его области связи. Чем глубже уровень нейрона, тем больше становится его рецептивная область. Таким образом, каждый нейрон последнего слоя воспринимает весь входной образ неокогнитрона. Размеры областей связи выбираются таким образом, чтобы для соседних нейронов они перекрывались, а все вместе покрывали входной образ целиком.

Рисунок 1.2 - Области связи

Описание нейронов

Все нейроны, используемые в неокогнитроне, являются аналоговыми, т.е. их входы и выходы имеют не-отрицательное вещественное значение. Всего используется 3 типа нейронов - S-нейроны, C-нейроны и тормозящие нейроны.

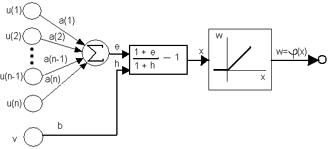

Рассмотрим функционирование S-нейрона. Как показано на рисунке 2, он получает множество возбуждающих входных сигналов от нейронов C-слоя - U(k), которые увеличивают его выходной сигнал. С другой стороны, влияние выходного сигнала тормозящего нейрона - v, - уменьшает его реакцию. Каждое соединение с нейроном предыдущего слоя имеет свой положительный коэффициент - a(k). Коэффициент соединения с тормозящим нейроном обозначен как b.

Рисунок 1.3 - Входные соединения S-нейрона

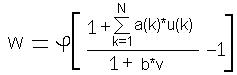

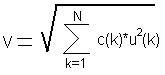

Обозначим выходной сигнал S-нейрона как w. Он вычисляется по формуле, приведенной в рис. 3

Функция активации является линейной при положительных значениях входного сигнала, и равной нулю в остальных случаях.

Тормозящий нейрон имеет ту же область связи, что и S-нейрон.

Выход тормозящего нейрона определяется по следующей формуле

Коэффициенты предсинаптических связей с C-слоем тормозящего нейрона зафиксированы и не изменяются, а их значения уменьшаются от середины области связи к ее краям, причем их сумма равна 1.

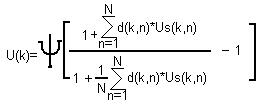

Рассмотрим вычислительные процессы, связанные с работой C-нейрона. Коэффициенты связей от S-слоя к C-слою определяются один раз и не изменяются в дальнейшем, их значения определяются аналогично коэффициентам тормозящих нейронов. Выходное значение C-нейрона определяется по формуле:

где функция кси дает значение x/(a+x) при положительном x, и 0 - в противном случае.

Алгоритм обучения неокогнитрона

Обучение неокогнитрона происходит по методу "обучение без учителя", т.е. в процессе обучения неокогнитрону подаются на вход образы без дополнительной информации о том, какому классу они принадлежат. Обучение выполняется последовательно, от слоя к слою.

Рисунок 1.1 - Демонстрация распознавания

Как упоминалось выше, изменяются только a(k) и b-коэффициенты S-нейронов по следующим формулам:

![]()

где q - коэффициент обучения, u(k) - выход k-го нейрона С-слоя, c(k) - весовой коэффициент предсинаптической связи тормозящего нейрона, v - выход тормозящего нейрона.

Изначально весовые коэффициенты a(k) и b принимают значения, близкие к нулю.

Процесс обучения ориентирован на то, чтобы каждая отдельная плоскость нейронов S-слоя обучилась реагировать на отдельную особенность входного образа. Но могут возникнуть такие ситуации, что нейроны в разных плоскостях при обучении на одних и тех же образах дадут достаточно высокие выходные сигналы и увеличат свои коэффициенты. Чтобы этого избежать, были введены столбцы конкуренции. Для каждого нейрона выбирается область определенного размера, в которую входит определенное число соседей. Эта область - область среза для одного из столбцов. В этот же столбец входят нейроны из той же самой области всех остальных плоскостей данного слоя. Столбцы, также как и области связи, могут частично перекрывать друг друга.

После того, как были посчитаны выходные сигналы для всех нейронов S-слоя, в каждом столбце конкуренции выбирается кандидат - нейрон, имеющий наибольший выходной показатель. Этот нейрон записывается в список кандидатов для плоскости, в которой находится. Затем, для каждой плоскости, из ее списка выбирается кандидат с максимальным выходом, и изменяются весовые коэффициенты его синаптических связей. Эти коэффициенты копируются на все нейроны этой же плоскости. Таким образом, на каждую особенность входного образа будут реагировать нейроны только одной плоскости.

Текущие результаты

На данный момент реализована система, которая успешно справляется с задачей распознавания арабских цифр. Реализован алгоритм чтения входного образа. Реализованы алгоритмы распознавания и обучения. Были проведены испытания работающей системы. На компьютере с процессором Intel Celeron 900Mhz процесс обучения на образах с разрешением 19x19, в ходе которого каждый образ подавался на вход нейросети 100 раз, длится 10.3 секунды, а процесс распознавания - 0.1 секунды. Неокогнитрон успешно

В настоящее время ведется разработка автоматизированного процесса обучения на наборах образов. Ведутся исследования по улучшению характеристик нейроалгоритма.

Выводы

Неокогнитрон показал очень хорошие результаты при распознавании образов. Развитие данной модели является очень перспективной задачей, решение которой позволит создать универсальную систему по идентификации различных объектов. На данный момент система обладает рядом недостатков, таких как низкая скорость обучения, жесткие параметры входных образов. Но эти проблемы являются разрешимыми.

Список литературы

- Fukushima K. Neocognitron: a self-organising neural network for mechanism of pattern recognition unaffected by shift in position. Biological Cybernetics 36, 1980, pp. 193-202.

- Fukumi, S. Omatu, and Y. Nishikawa, Rotation-Invariant Neural Pattern Recognition System Estimating a Rotation Angle, IEEE, Trans., Neural Network, 8, 1997, pp. 568-581.

- D. R. Lovell, A. C. Tsoi and T. Downs, "A Note on a Closed-form Training Algorithm for the Neocognitron," To appear in IEEE Transactions on Neural Networks.

- S. Satoh, J. Kuroiwa, H. Aso and S. Miyake, "Recognition of Hand-written Patterns by Rotation-invariant Neocognitron," Proc. of ICONIP'98, 1, pp. 295-299, 1998.

- S. Satoh, J. Kuroiwa, H. Aso and S. Miyake, "Pattern Recognition System with Top-Down Process of Mental Rotation," Proc. of IWANN'99, 1, pp. 816-825, 1999.

ДонНТУ| Портал магистров ДонНТУ

Реферат | Библиотека | Ссылки | Отчет о поиске | Индивидуальное задание