Исходный URL: http://ann.hotmail.ru/vs04.htm

История

Под RBFN понимается архитектура, предложенная Муди (Moody) и Даркеном (Darken) в 1989 г.

К классу RBFN относят также регрессионные и вероятностные искусственные нейронные сети.

Структура

Обычно в сетях радиального базиса задействовано больше нейронов, чем стандартных прямонаправленных

сетях, но зачастую на создание RBFN требуется меньше времени, чем на тренировку прямонаправленных

сетей.

Рисунок 1. - Сеть радиального базиса с R входами

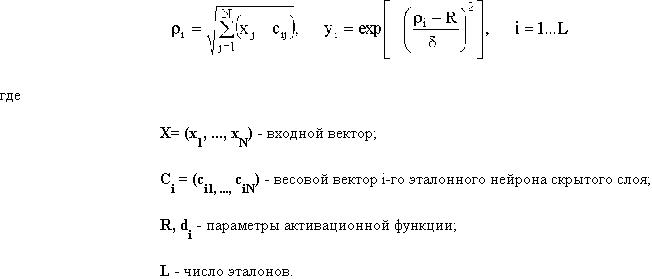

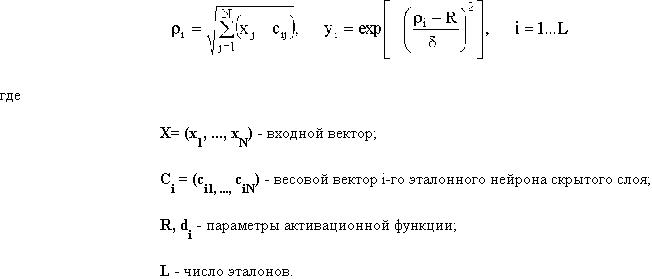

В общем случае под термином RBFN подразумевается нейронная сеть, состоящая из двух слоев нейронов. Слоя скрытых нейронов с радиально-симметричной активационной функцией, каждый из которых предназначен для хранения отдельного эталонного вектора (в виде вектора весов) S 1 и выходного линейного слоя S 2.

Рисунок 2. - Сеть радиального базиса со скрытым слоем

||dist|| принимает входной вектор p и вектор входных весов IW 1,1 и

производит вектор, имеющий S1 элементов. Эти элементы являются расстояниями между входным

вектором и вектором входных весов.

Вектор смещений b1 и выход ||dist|| объединяются при помощи поэлементного умножения.

Для построения RBFN необходимо выполнение следующих условий.

Обучение слоя образцов-нейронов сети подразумевает предварительное проведение

кластеризации для нахождения эталонных векторов и определенных эвристик для определения значений

d i.

Нейроны скрытого слоя соединены по полносвязной схеме с нейронами выходного слоя, которые

осуществляют взвешенное суммирование. Для нахождения значения весов от нейронов скрытого к

выходному слою используется линейная регрессия.

Области применения

Распознавание образов, классификация.

Недостатки

Сеть уверенно "работает" только с теми образами, которые были "предъявлены" в процессе создания.

Заранее должно быть известно число эталонов, а также эвристики для построения активационных функций нейронов скрытого слоя.

Достоинства

Отсутствие этапа обучения в общепринятом смысле этого слова.

Модификации.

В моделях RBFN могут быть использованы различные способы измерения расстояния между векторами,

а также функции активации нейронов скрытого слоя.