Источник информации: Вентцель Е. С. Теория вероятностей. – М.: Наука, 1969. – 576 с.

Рассмотривались числовые характеристики одной случайной величины X — начальные и центральные моменты различных порядков. Из этих характеристик важнейшими являются две: математическое ожидание mх и дисперсия Dх.

Аналогичные числовые характеристики — начальные и центральные моменты различных порядков — можно ввести и для системы двух случайных величин.

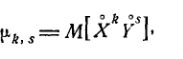

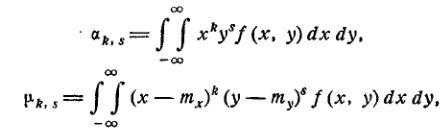

Начальным моментом порядка k, s системы (X, Y) называется математическое ожидание произведения Xk на Ys:

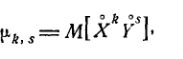

Центральным моментом порядка k, s системы (X, Y) называется математическое ожидание произведения k-й и s-й степени соответствующих центрированных величин:

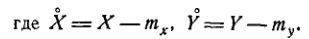

Выпишем формулы, служащие для непосредственного подсчета моментов. Для прерывных случайных величин

где pij= P((X=xi)(Y=yj)) — вероятность того, что система (X, Y) примет значения (xi, yj), а суммирование распространяется по всем возможным значениям случайных величин X, Y.

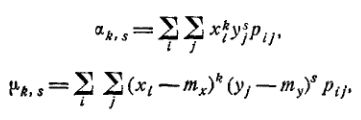

Для непрерывных случайных величин:

где f(x, у) — плотность распределения системы.

Помимо чисел k и s, характеризующих порядок момента по отношению к отдельным величинам, рассматривается еще суммарный порядок момента k + s, равный сумме показателей степеней при Х и У. Соответственно суммарному порядку моменты классифицируются на первые, вторые и т. д. На практике обычно применяются только первые и вторые моменты.

Первые начальные моменты представляют собой уже известные нам математические ожидания величин Х и У, входящих в систему:

Совокупность математических ожиданий mх, my представляет собой характеристику положения системы. Геометрически это координаты средней точки на плоскости, вокруг которой происходит рассеивание точки (X, У).

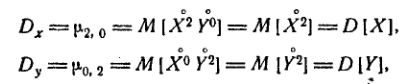

Кроме первых начальных моментов, на практике широко применяются еще вторые центральные моменты системы. Два из них представляют собой уже известные нам дисперсии величин Х и У:

характеризующие рассеивание случайной точки в направлении осей Ох и Оу.

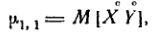

Особую роль как характеристика системы играет второй смешанный центральный момент:

т. е. математическое ожидание произведения центрированных величин.

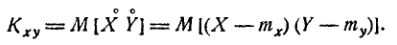

Ввиду того, что этот момент играет важную роль в теории систем случайных величин, введем для него особое обозначение:

Характеристика Kхy называется корреляционным моментом (иначе — «моментом связи») случайных величин X, У.

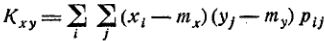

Для прерывных случайных величин корреляционный момент выражается формулой

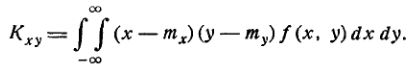

а для непрерывных — формулой

Выясним смысл и назначение этой характеристики.

Корреляционный момент есть характеристика системы случайных величин, описывающая, помимо рассеивания величин Х и У, еще и связь между ними. Для того чтобы убедиться в этом, докажем, что для независимых случайных величин корреляционный момент равен нулю.

Доказательство проведем для непрерывных случайных величин. Пусть Х, У — независимые непрерывные величины с плотностью распределения f(x, у). Для независимых величин

где f1(x), f2(y) — плотности распределения соответственно величин Х и У.

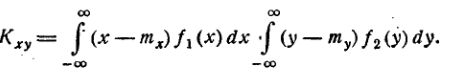

После подстановки видим, что интеграл (превращается в произведение двух интегралов:

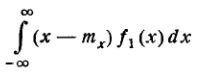

Интеграл

представляет собой не что иное, как первый центральный момент величины X, и, следовательно, равен нулю; по той же причине равен пулю и второй сомножитель; следовательно, для независимых случайных величин Kxy = 0.

Таким образом, если корреляционный момент двух случайных величин отличен от нуля, это есть признак наличия зависимости между ними.

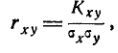

Kорреляционный момент характеризует не только зависимость величин, но и их рассеивание. Действительно, если, например, одна из величин (Х, У) весьма мало отклоняется от своего математического ожидания (почти не случайна), то корреляционный момент будет мал, какой бы тесной зависимостью ни были связаны величины (Х, У). Поэтому для характеристики связи между величинами (Х, У) в чистом виде переходят от момента Kxy к безразмерной характеристике

где σx, σy —средние квадратические отклонения величин X, Y. Эта характеристика называется коэффициентом корреляции величин Х и У. Очевидно, коэффициент корреляции обращается в нуль одновременно с корреляционным моментом; следовательно, для независимых случайных величин коэффициент корреляции равен нулю.

Случайные величины, для которых корреляционный момент (а значит, и коэффициент корреляции) равен нулю, называются некоррелированными (иногда — «несвязанными»).

Выясним, эквивалентно ли понятие некоррелированности случайных величин понятию независимости. Выше мы доказали, что две независимые случайные величины всегда являются некоррелированными. Остается выяснить: справедливо ли обратное положение, вытекает ли из некоррелированности величин их независимость? х Оказывается — нет. Можно построить примеры таких случайных величин, которые являются некоррелированными, но зависимыми. Равенство нулю коэффициента корреляции — необходимое, но не достаточное условие независимости случайных величин. Из независимости случайных величин вытекает их некоррелированность; напротив, из некоррелированности величин еще не следует их независимость. Условие независимости случайных величин — более жесткое, чем условие некоррелированности.

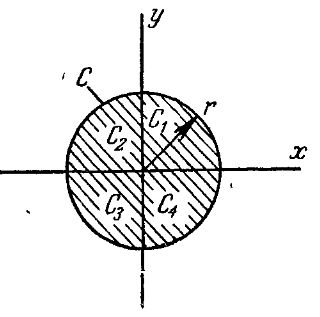

Убедимся с этом ка примере. Рассмотрим систему случайных величин (Х, У), распределенную с равномерной плотностью внутри круга С радиуса r с центром в начале координат (рис. 1).

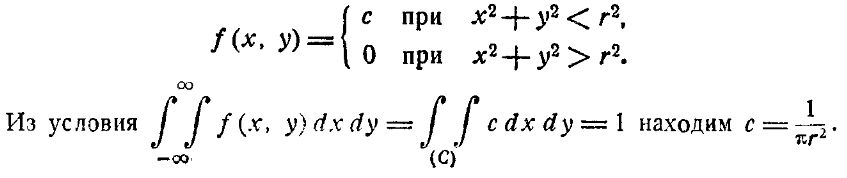

Плотность распределения величин (Х, У) выражается формулой

Нетрудно убедиться, что в данном примере величины являются зависимыми. Действительно, непосредственно ясно, что если величина X приняла, например, значение 0, то величина Y может с равной вероятностью принимать все значения от — r до +r; если же величина X приняла значение r, то величина Y может принять только одно-единственное значение, в точности равное нулю; вообще, диапазон возможных значений Y зависит от того, какое значение приняла X.

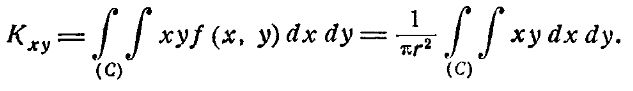

Посмотрим, являются ли эти величины коррелированными. Вычислим корреляционный момент. Имея в виду, что по соображениям симметрии mх = my = 0, получим:

Для вычисления интеграла разобьем область интегрирования (круг С) на четыре сектора С1 С2, С3, С4, соответствующие четырем координатным углам. В секторах С1 и С3 подынтегральная функция положительна, в секторах С2 и С4 — отрицательна; по абсолютной же величине интегралы по этим секторам равны; следовательно, интеграл равен нулю, и величины (Х, У) не коррелированы.

Таким образом, мы видим, что из некоррелированности случайных величин не всегда следует их независимость.

Коэффициент корреляции характеризует не всякую зависимость, а только так называемую линейную зависимость. Линейная вероятностная зависимость случайных величин заключается в том, что при возрастании одной случайной величины другая имеет тенденцию возрастать (или же убывать) по линейному закону. Эта тенденция к линейной зависимости может быть более или менее ярко выраженной, более или менее приближаться к функциональной, т. е. самой тесной линейной зависимости. Коэффициент корреляции характеризует степень тесноты линейной зависимости между случайными величинами. Если случайные величины Х и У связаны точной линейной функциональной зависимостью:

то rxy= ±1, причем знак «плюс» или «минус» берется в зависимости от того, положителен или отрицателен коэффициент а. В общем случае, когда величины Х и У связаны произвольной вероятностной зависимостью, коэффициент корреляции может иметь значение в пределах:

В случае rxy > 0 говорят о положительной корреляции величин Х и У, в случае rxy < 0 — об отрицательной корреляции. Положительная корреляция между случайными величинами означает, что при возрастании одной из них другая имеет тенденцию в среднем возрастать; отрицательная корреляция означает, что при возрастании одной из случайных величин- другая имеет тенденцию в среднем убывать.

В рассмотренном примере двух случайных величин (Х, У), распределенных внутри круга с равномерной плотностью, несмотря на наличие зависимости между Х и У, линейная зависимость отсутствует; при возрастании Х меняется только диапазон изменения У, а его среднее значение не меняется; естественно, величины (Х, У) оказываются некоррелированными.

Приведем несколько примеров случайных величин с положительной и отрицательной корреляцией.

1. Вес и рост человека связаны положительной корреляцией.

2. Время,. потраченное на регулировку прибора при подготовке его к работе, и время его безотказной работы связаны положительной корреляцией (если, разумеется, время потрачено разумно). Наоборот, время, потраченное на подготовку, и количество неисправностей, обнаруженное при работе прибора, связаны отрицательной корреляцией.

3. При стрельбе залпом координаты точек попадания отдельных снарядов- связаны положительной корреляцией (так как имеются общие для всех выстрелов ошибки прицеливания, одинаково отклоняющие от цели каждый из них).

4. Производится два выстрела по цели; точка попадания первого выстрела регистрируется, и в прицел вводится поправка, пропорциональная ошибке первого выстрела с обратным знаком. Координаты точек попадания первого и второго выстрелов будут связаны отрицательной корреляцией.

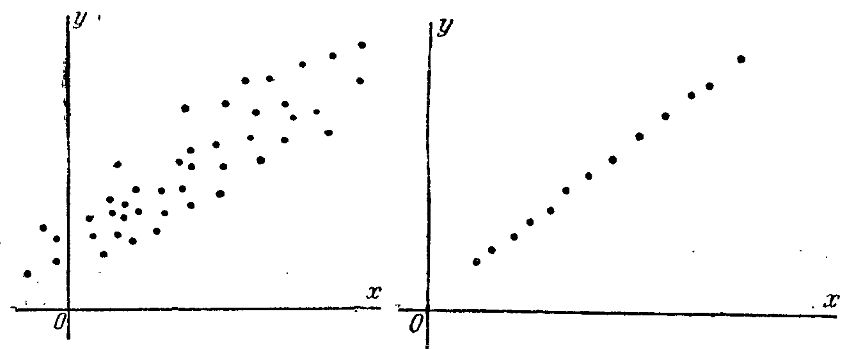

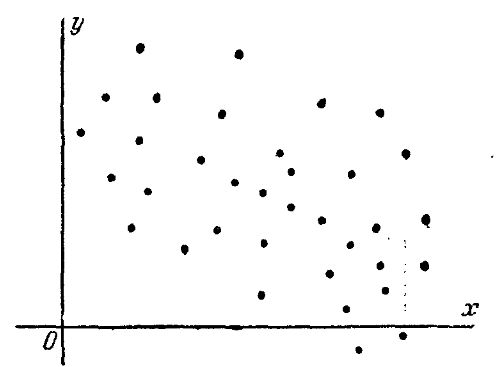

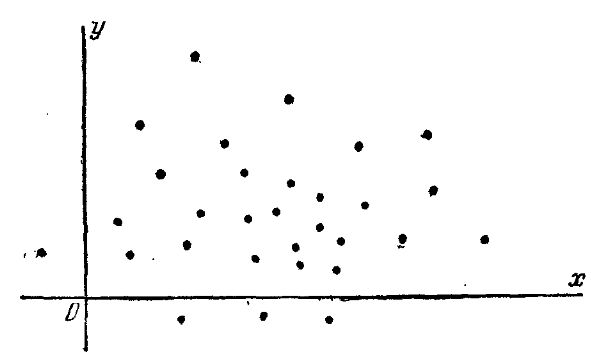

Если в нашем распоряжении имеются результаты ряда опытов над системой двух случайных величин (Х, У), то о наличии или отсутствии существенной корреляции между ними легко судить в первом приближении по графику, на котором изображены в виде точек все полученные из опыта пары значений случайных величин. Например, если наблюденные пары значений величин расположились так, как показано на рис. 2, то это указывает на наличие явно выраженной положительной корреляции между величинами. Еще более ярко выраженную положительную корреляцию, близкую к линейной функциональной зависимости, наблюдаем на рис. 3. На рис. 4 показан случай сравнительно слабой отрицательной корреляции. Наконец, на рис. 5 иллюстрируется случай практически некоррелированных случайных величин. На практике, перед тем как исследовать корреляцию случайных величин, всегда полезно предварительно построить наблюденные пары значений на графике для первого качественного суждения о типе корреляции.