Реферат за темою випускної роботи

Зміст

- Вступ

- 1. Актуальність теми

- 2. Мета і задачі дослідження та заплановані результати

- 3. Огляд досліджень та розробок

- 3.1 Огляд міжнародних джерел

- 3.2 Огляд локальних джерел

- 4. Аналіз методів і визначення найбільш ефективного

- Висновки

- Перелік посилань

Вступ

В наш час розробка та дослідження людино-машинної взаємодії, заснованної на розпізнаванні образів і візуальному представленні мультимедійної інформації, стає переднім краєм у розвитку сучасного математичного та програмного забезпечення. Перед розробниками подібних інтерфейсів ставиться завдання використання природних для людини способів спілкування з комп'ютерами за допомогою жестів, голосу, міміки та інших модальностей. Жести є особливо перспективними для побудови інтерфейсів управління програмним і апаратним забезпеченням комп'ютерів, роботів, дозволяють розширити можливості інтерфейсу для людей з дефектами слуху й мови.

1. Актуальність теми

Актуальність теми дипломного проекту з теоретичної точки зору диктується необхідністю розробки методів, моделей і алгоритмів захоплення, відстеження та розпізнавання жестів, скоєних людиною в реальному часі, зокрема руками, придатних для створення інтерфейсу управління роботою комп'ютера з їх допомогою.

Актуальність теми з прикладної точки зору визначається необхідністю створення програмних систем, здатних забезпечити за допомогою жестів інтерфейс з персональним комп'ютером в реальному часі.

У дипломному проекті розглядається задача розпізнавання жестів на основі інформації, отриманої з доступних візуальних сенсорів, таких як камери глибини.

У літературі розглядаються різні методи вирішення задач розпізнавання окремих класів жестів. Зокрема, досить багато робіт, присвячені визначенню статичної пози руки, при використанні RGB камери в якості сенсора. Але запропоновані рішення або працюють з найпростішими одиночними жестами, або володіють великою обчислювальною складністю, яка не дозволяє використовувати їх в системах реального часу.

Поява сенсора Kinect в 2010 році, першої камери глибини доступною широкій аудиторії, відкрило широкі можливості для створення систем розпізнавання жестів, що надзвичайно підвищило актуальність проблеми розпізнавання жестів з використанням камери глибини. А розроблене для Kinect програмне забезпечення виконує визначення положень основних суглобів тіла людини. Однак у ньому відсутній механізм розпізнавання динамічних жестів, більше того дане програмне забезпечення є закритим, і для відтворення методу, який лежить в його основі, потрібна велика база даних всіляких поз людини для навчання класифікатора.

У цілому, рішення задач, пов'язаних з розпізнаванням складних динамічних жестів знаходиться на початковому рівні. А різноманітність жестів і здатність людини до їх розуміння настільки великі, що проблема їх розпізнавання за допомогою комп'ютера буде залишатися актуальною довгий час.

2. Мета і задачі дослідження та заплановані результати

Метою дослідження є аналіз і розробка існуючих методів розпізнавання жестів за допомогою камери глибина, підвищення їх ефективності, а також їх реалізація на платформі Microsoft Kinect.

Основні завдання дослідження:

- Аналіз методів розпізнавання жестів руки, заснованих на камері глибини, і визначення найбільш точного з них.

- Розробка модифікованих методів розпізнавання жестів.

- Реалізація методів з використанням платформи Microsoft Kinect.

- Провести експериментальні дослідження характеристик методів.

Об'єкт дослідження: методи, алгоритми і програми захоплення, відстеження та розпізнавання жестів людської руки.

Предмет дослідження: модифікація методів розпізнавання жестів, з метою підвищення точності і продуктивності.

3. Огляд досліджень та розробок

Перший сенсор глибини з'явився лише недавно (у 2010 р.), тому було проведено не багато досліджень в області розпізнавання жестів руки з використанням камери глибини.

3.1 Огляд міжнародних джерел

Перший сенсор глибини випустила компанія Microsoft, спочатку представлений для консолі Xbox 360 в 2010 р., і пізніше для персональних комп'ютерів під управлінням ОС Windows в 2012 р. [1]. Існують такок і альтернативні сенсори глибини: Xtion Pro [2], Leap Motion [3], DUO 3D [4], Intel Perceptual Computing [5].

Розпізнавання жестів руки стосується 2 складних проблем: визначення руки і розпізнавання жесту (рис. 3.1).

Рисунок 3.1 - Схема розпізнавання жестів руки

Існують різні методи виявлення руки на зображенні. Ці методи можна розділити на дві групи: методи на основі зовнішнього вигляду руки (Vision-based approach) і методи на основі 3D-моделі руки (3D hand model based approach). У методах на основі зовнішнього вигляду руки [6-19] при моделюванні використовуються двовимірні параметри зображення, які порівнюються з такими ж параметрами, які виділенні на вхідному зображенні. У методах на основі 3D-моделі застосовуються кінематичні 3D-моделі руки, за допомогою яких можна оцінити параметри руки, порівнюючи їх з двовимірними проекціями цих 3D-моделей. У методах першого типу використовуються такі ознаки, як колір шкіри [12-14], образи руки [15,16], локальні ознаки [11,17], оптичний потік [18,19]. Кожен метод має переваги і недоліки. Методи на основі кольору шкіри мають високу швидкість виконання і можуть працювати в реальному часі, але при цьому залежать від зміни освітлення або не дозволяють відрізнити руку від речей, колір яких подібний кольору шкіри. Методи з використанням образів руки і локальних ознак працюють так само швидко, але на складному тлі не забезпечують точне виявлення. Оптичний потік дозволяє виявити тільки рухомі об'єкти. Методи на основі 3D-моделей [20-26] забезпечують більшу ступінь свободи (можна виявляти і одночасно розпізнавати різні форми руки), але вимагають великого обсягу обчислень і наявності великої бази даних, що включає всі пози руки.

Популярні методи для визначення руки: методи на основі фільтра Калмана [27,28], методи, які використовують маркери (перчатки) [29], методи, які використовують колір шкіри [30,31], методи, які використовують дані про глибину [42].

У роботі [32] описан метод Джонса - Віоли з використанням ознак Хаара і AdaBoost класифікатора для виявлення руки. Головна перевага цього методу полягає у високій швидкості його виконання. В [33] показано, що метод Джонса Віоли може обробляти до 15 кадр/с, тобто дозволяє працювати в реальному часі.

В [34,35] пропонується метод, який синхронізує віртуальну руку (рис. 3.2), зібрану з примітивів, з реальної рукою. Віртуальна рука представлена ??27 параметрами і завдання полягає в підборі значень цих параметрів так, що б вони найбільш точно характеризували жест реальної руки. В основі лежить метод рою частинок (МРЧ) [36-38]. Програмну реалізацію можна скачати за адресою [45], там же є і бібліотека для не комерційного використання. В [39] представлен цей же метод тільки для одночасного стеження за 2-ма руками.

Рисунок 3.2 - Віртуальна модель 3D руки

У роботі [40] для розпізнавання і стеження за рукою використовується прихована Марковська модель.

В [41] об'єднали 2 приладу для отримання даних про руку, Kinect і спеціальний тактильний прилад, що одягається на руку.

В [42] для визначення жесту руки використовується метод подібності контурів, а для визначення 3D траєкторії використовується машина кінцевих автоматів.

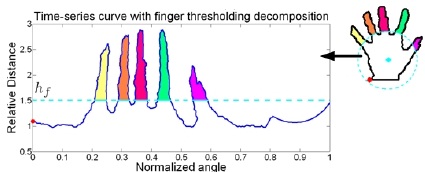

У роботі [43] пропонується метод Finger-Earth Mover's Distance (FEMD) для розпізнавання жестів руки, метод пропонує представити дані руки, отримані з камери глибини, у вигляді кривої (рис. 3.3) і далі працювати з кривою.

Рисунок 3.3 - Крива метода Finger-Earth Mover’s Distance

3.2 Огляд національних джерел

Для ДонНТУ наукова проблема розпізнавання жестів за допомогою камери глибини є новою.

На кафедрі ПМІ дослідженням розробок, пов'язаних з камерою глибини (Kinect), займається Бабков Віктор Светозарович. Так само випускник ДонНТУ Соболєв Євген Георгійович в рамках своєї дипломної роботи [44] займався тривимірним скануванням об'єктів з використанням платформи Microsoft Kinect під керівництвом В.С. Бабкова.

4. Аналіз методів і визначення найбільш ефективного

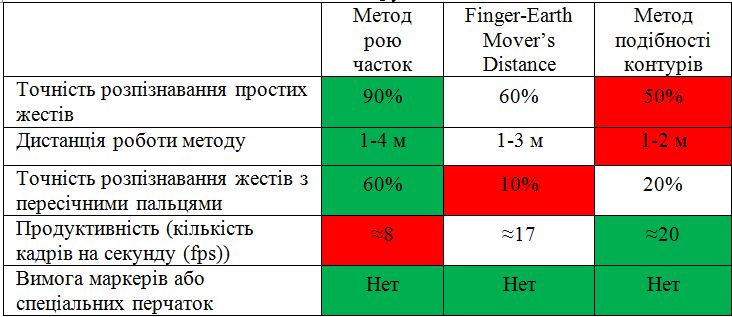

Досліджено кілька методів для розпізнавання жестів руки: метод рою частинок [34,35], метод Finger-Earth Mover's Distance [43] і метод подібності контурів [42]. Виділили кілька основних характеристик методів і побудували порівняльну таблицю (табл. 4.1). У табл. 4.1 зеленим виділені кращі показники методів, а червоним - найгірші.

Таблиця 4.1 – Порівняльна характеристика методів розпізнавання жестів руки

В [45] виконана програмна реалізація методу рою частинок, яка стежить за рукою, в тому числі і за всіма 5-ма пальцями (рис. 4.2).

Рисунок 4.2 - Синхронізація віртуальної і реальної руки

(анімація: 11 кадрів, 10 циклів повторення, 113 кілобайт)

Висновки

Проведено аналіз методів розпізнавання жестів руки. Визначено найбільш точний метод, їм є підхід заснований на методі рою частинок [34, 35].

Магістерська робота присвячена дослідженню точних методів розпізнавання жестів руки на основі тривимірного сканування. У рамках проведених досліджень виконано:

- Проведено аналіз методів розпізнавання жестів руки, заснованих на камері глибини

- Дали порівняльну оцінку методам.

- Визначили найбільш точні з них.

Подальші дослідження спрямовані на наступні аспекти:

- Розробка модифікованих методів розпізнавання жестів.

- Реалізація методів з використанням платформи Microsoft Kinect.

- Дати оцінку отриманим результатам.

При написанні даного реферату магістерська робота ще не завершена. Остаточне завершення: січень 2014 року. Повний текст роботи та матеріали по темі можуть бути отримані у автора або його керівника після зазначеної дати.

Перелік посилань

- Kinect - Wikipedia [Електронний ресурс]. – Режим доступу: http://ru.wikipedia.org/wiki/Kinect

- Asus Xtion Pro [Електронний ресурс]. – Режим доступу: http://ru.asus.com/Multimedia/Motion_Sensor/Xtion_PRO/

- Leap Motion [Електронний ресурс]. – Режим доступу: https://www.leapmotion.com/

- DUO 3D [Електронний ресурс]. – Режим доступу: http://duo3d.com/

- Intel Perceptual Computing [Електронний ресурс]. – Режим доступу: https://perceptualchallenge.intel.com/

- C. Chua, H. Guan, and Y. Ho. Model-based 3d hand posture estimation from a single 2d image. Image and Vision Computing, 20:191 - 202, 2002.

- N. Shimada, Y. Shirai, Y. Kuno, and J. Miura. Hand gesture estimation and model refinement using monocular camera-ambiguity limitation by inequality constraints. In Proc. of Third IEEE International Conf. on Face and Gesture Recognition, 1998.

- B. Stenger, A. Thayananthan, P. Torr, and R. Cipolla. Filtering using a tree-based estimator. In Proc. of IEEE ICCV, 2003.

- Moeslund, T.B., Hilton, A., Kruger, V.: A survey of advances in vision-based human motion capture and analysis. CVIU 104 (2006) 90–126

- Erol, A., Bebis, G., Nicolescu, M., Boyle, R.D., Twombly, X.: Vision-based hand pose estimation: A review. CVIU 108 (2007) 52–73

- K. Oka, Y.Sato and H. Koike, “Real-Time Fingertip Tracking and Gesture Recognition”, IEEE Computer Graphics and Applications, November-December, 2002, pp. 64-71.

- WU Y., HUANG T. S. Non-stationary color tracking for vision-based human computer interaction // IEEE Trans. Neural Networks. 2002. V. 13, N 4. P. 948– 960.

- MANRESA C., VARONA J., MAS R., PERALES F. J. Hand tracking and gesture recognition for humancomputer interaction // Electron. Lett. Comput. Vision Image Anal. 2005. V. 5, N 3. P. 96–104.

- MCKENNA S., MORRISON K. A comparison of skin history and trajectory-based representation schemes for the recognition of user-specific gestures // Pattern Recognition. 2004. V. 37. P. 999–1009.

- CHEN F., FU C., HUANG C. Hand gesture recognition using a real-time tracking method and hidden Markov models // Image Vision Comput. 2003. V. 21, N 8. P. 745–758.

- NG C. W., RANGANATH S. Gesture recognition via pose classification // Proc. of the 15th Intern. conf. on pattern recognition, Barcelona (Spain), 3–7 Sept. 2000. Washington DC: IEEE Computer Soc., 2000. V. 3. P. 699–704.

- HUANG C., JENG S. A model-based hand gesture recognition system // Machine Vision Appl. 2001. V. 12, N 5. P. 243–258.

- CUTLER R., TURK M. View-based interpretation of real-time optical flow for gesture recognition // Proc. of the 3rd IEEE conf. on face and gesture recognition, Nara (Japan), 14–16 Apr. 1998. Washington DC: IEEE Computer Soc., 1998. P. 416–421.

- LU S., METAXAS D., SAMARAS D., OLIENSIS J. Using multiple cues for hand tracking and model refinement // Proc. of the IEEE conf. on computer vision and pattern recognition, Madison (USA), 16–22 June 2003. Washington DC: IEEE Computer Soc., 2003. P. 443–450.

- Athitsos, V., Sclaroff, S.: Estimating 3d hand pose from a cluttered image. CVPR 2 (2003) 432

- Rosales, R., Athitsos, V., Sigal, L., Sclaroff, S.: 3d hand pose reconstruction using specialized mappings. In: ICCV. (2001) 378–385

- Romero, J., Kjellstrom, H., Kragic, D.: Monocular real-time 3D articulated hand pose estimation. IEEE-RAS Int’l Conf. on Humanoid Robots (2009) 87–92

- Rehg, J.M., Kanade, T.: Visual tracking of high dof articulated structures: An application to human hand tracking. In: ECCV, Springer-Verlag (1994) 35–46

- Stenger, B., Mendonca, P., Cipolla, R.: Model-based 3D tracking of an articulated hand. CVPR (2001) II–310–II–315

- Sudderth, E., Mandel, M., Freeman, W., Willsky, A.: Visual hand tracking using nonparametric belief propagation. In: CVPR Workshop. (2004) 189189

- de la Gorce, M., Paragios, N., Fleet, D.: Model-based hand tracking with texture, shading and self-occlusions. In: CVPR. (2008) 1–8

- S. J. Julier, J. K. Uhlmann, and H. F. Durrant-Whyte. A new approach for filtering nonlinear systems. In Proc. American Control Conference, pages 1628–1632, Seattle, USA, June 1995.

- E. A. Wan and R. van der Merve. The Unscented Kalman Filter for nonlinear estimation. In Proc. of IEEE Symposium 2000 on Adaptive Systems for Signal Processing, Communications and Control, pages 153–158, Lake Louise, Canada, Oct. 2000.

- A. Zafrulla, H. Brashear, H. Hamilton, T. Starner. “A novel approach to American Sign Language (ASL) Phrase Verification using Reversed Signing.” Computer Vision and Pattern Recognition Workshops, 2010.

- M. J. Jones and J. M. Rehg. "Statistical Color Models with Application to Skin Detection." IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 1999.

- Antonis A. Argyros and Manolis Lourakis. Real-time Tracking of Multiple Skincolored Objects with a Possibly Moving Camera. pages 368–379. Springer, 2004.

- Т.Т. Нгуен. Обнаружение руки в режиме реального времени в видеопотоке с помощью признаков Xаара и Adaboost-классификатора. // Средства и системы обработки и анализа данных, 2011. c. 76-80.

- VIOLA P., JONES M. Rapid object detection using a boosted cascade of simple features // Proc. of the IEEE conf. on computer vision and pattern recognition. Washington DC: IEEE Computer Soc., 2001. P. 511–518.

- Iason Oikonomidis, Nikolaos Kyriazis, and Antonis A. Argyros. Full DOF Tracking of a Hand Interacting with an Object by Modeling Occlusions and Physical Constraints. In ICCV, 2011. To appear.

- Project Report, December 18, 2003. I. Oikonomidis, N. Kyriazis, and A. Argyros, “Efficient model-based 3D tracking of hand articulations using Kinect”, in BMVC 2011, 2011.

- Sabine Helwig and Rolf Wanka. Particle Swarm Optimization in High-Dimensional Bounded Search Spaces. In Swarm Intelligence Symposium, pages 198–205. IEEE, 2007.

- Vijay John, Spela Ivekovic, and Emanuele Trucco. Articulated Human Motion Tracking with HPSO. International Conference on Computer Vision Theory and Applications, 2009.

- James Kennedy and Russ Eberhart. Particle Swarm Optimization. In International Conference on Neural Networks, volume 4, pages 1942–1948. IEEE, January 1995.

- Iason Oikonomidis, Nikolaos Kyriazis, and Antonis A. Argyros. Tracking the Articulated Motion of Two Strongly Interacting Hands, 2012.

- C. Keskin, A. Erkan, L. Akarun. Real time hand tracking and 3d gesture recognition for interactive interfaces using HMM, 2003.

- V. Frati, D. Prattichizzo. Using Kinect for hand tracking and rendering in wearable haptics, 2011.

- Zhi Li, Ray Jarvis. Real time Hand Gesture Recognition using a Range Camera. ACRA, 2009.

- Zhou Ren, Junsong Yuan, Zhengyou Zhang. Robust Hand Gesture Recognition Based on Finger-Earth Mover’s Distance with a Commodity Depth Camera. Published by ACM 2011.

- Е.Г. Соболев. Средства интерактивного взаимодействия реального и виртуального пространств на основе трехмерного сканирования объектов с использованием платформы Microsoft Kinect [Електронний ресурс]. – Режим доступу: http://masters.donntu.ru/2012/fknt/sobolev/diss/index.htm

- Kinect 3D Hand Tracking [Електронний ресурс]. – Режим доступу: http://cvrlcode.ics.forth.gr/handtracking/